基于RISC-V AI CPU芯片K1与OpenHarmony 5.0生态,进迭时空采用融合AI架构实现首个RISC-V + OpenHarmony + 本地大模型的全栈方案,可以在进迭时空MUSE Paper平板上部署通义千问0.5B、1.5B以及DeepSeek-R1-1.5B等大模型,打造从硬件到系统的全栈创新AI解决方案。无需复杂适配、无需高昂算力成本,适用终端设备大模型新AI智能化升级。

技术路线:同构融合AI架构

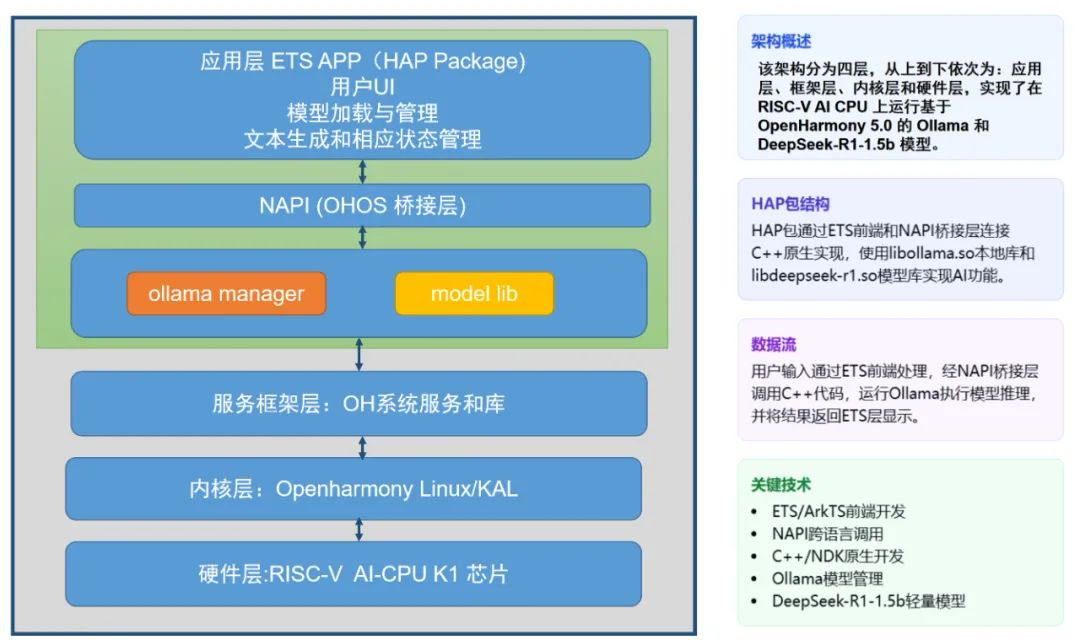

相对于传统“CPU + NPU”异构方案,进迭时空通过同构融合架构提供了一条新的技术路线:

1.统一指令集:共同使用RISC-V指令集驱动通用计算和AI计算。

2.开放可编程:便捷接入RISC-V开源生态,适配各种私有算子和新模型结构的迭代。

基于同构融合的架构,我们已经接入llamacpp及ollama生态,逐步接入Pytorch及vLLm等大模型生态中。

技术方案

模型运行环境(foundation/ai/ds_r1_service)

Ø 模型部署:

• 基础模型:DeepSeek-R1-1.5B-Q4(4bit 量化)

Ø 推理服务化:

• 实现 OHOS AI 标准接口

• 支持 JS/TS 跨语言调用

系统级优化(kernel/linux/arch/riscv)

Ø 调度策略:

• 推理进程绑定 CPU0-3(RV64 四核,屏蔽中断)

• 使用 SCHED_FIFO 实时调度(优先级 99,高于系统服务)

方案价值

全栈创新,安全与开放兼得

• 全栈创新:采用K1芯片+ OpenHarmony 5.0系统+本地大模型,实现从硬件到系统到算法的全栈创新。

• 数据安全:模型文件SELinux加密,在工业诊断、教育答题等敏感场景下,确保数据严格留存于本地设备,杜绝数据外流。

• 生态开放:拥抱开源生态,已接入llamacpp生态,即将支持ONNXRuntime生态,后续将逐步接入PyTorch及vLLM生态。

性能与成本平衡

• 快速推理:通过标准256bit RVV向量指令及自定义AI指令集,深度优化AI模型推理性能,提升0.5B和1.5B模型的运行速度。

• 8核智能调度:8核CPU智能分工——4核专注大模型推理任务,4核并行处理系统任务,性能有保障。

• 轻量部署:4GB跑1.5B参数模型,端侧设备直接安装。

高效开发,快速部署

• 提供完整的AI基础和OpenHarmony系统LLM运行库和应用开发demo。

• 轻松部署:标准化AI接口(OHOS IAiModelAgent),JS/TS跨语言一键调用。一键部署AI组件,运行LLM(10分钟完成LLM组件加载)。

应用场景

工业场景(边缘设备问答与控制)

采用K1芯片的工业网关,无需联网,即可实现本地响应设备故障咨询及本地故障诊断响应。

教育场景(智能学习辅导)

K1芯片教育平板,提供离线智能辅导、作业批改、趣味学习等功能,定义AI教育新模式。同时,模型文件存储受SELinux保护,仅AI服务可读写,保障数据安全。

家居场景(低功耗智能控制)

K1芯片智能语音设备,待机时主频降至600MHz,实现低功耗运行。

文档与生态

开发指南:《OH5.0 标准系统下 DeepSeek-R1 部署指南》

示例代码:提供 JS/TS 调用示例

兼容性声明:支持 OH5.0 标准系统 + SpacemiT K1产品发布计划

参考开发硬件平台:MUSE Paper

相关文档请登录https://archive.spacemit.com/tools/openharmony/ai/下载。

发表评论 取消回复